A Lei Felca é um desastre técnico, jurídico e civilizacional

Tem lei que nasce para resolver problema real. E tem lei que nasce para render manchete, acalmar pânico moral e jogar a conta da incompetência regulatória no colo de usuário.

Tem lei que nasce para resolver problema real. E tem lei que nasce para render manchete, acalmar pânico moral e jogar a conta da incompetência regulatória no colo de usuário, desenvolvedor e projeto pequeno. A Lei nº 15.211/2025, o chamado ECA Digital — apelidado de “Lei Felca” — infelizmente caiu nessa segunda categoria.

Vamos tirar a fumaça ideológica da frente e falar como gente adulta. Proteger criança e adolescente online é obrigação séria. Ninguém em sã consciência é a favor de exploração sexual, abuso, incentivo a automutilação, aposta para menor ou pornografia acessível a criança. O problema é que o legislador brasileiro pegou uma demanda legítima e respondeu com o tipo de martelada regulatória que dev velho já conhece: regra ampla demais, custo difuso, implementação nebulosa, incentivo perverso e poder de bloqueio como arma de última instância.

O texto da lei é absurdamente abrangente. Ela se aplica a produto ou serviço de tecnologia da informação “direcionado” a menores ou de “acesso provável” por eles. E o próprio texto inclui aplicações de internet, programas de computador, softwares, sistemas operacionais, lojas de aplicativos e jogos eletrônicos. Isso não é só rede social grande. Isso encosta em loja de app, plataforma de distribuição, software baixável, projeto comunitário, serviço pequeno, fórum, mirror, repositório e qualquer iniciativa que, de algum jeito, possa ser usada por menor de idade.

Pior: o art. 9º exige mecanismo confiável de verificação de idade “a cada acesso” para conteúdo, produto ou serviço impróprio ou inadequado para menores, e veda autodeclaração. O art. 12 joga para sistemas operacionais e lojas de aplicativos o dever de aferir idade com medidas “proporcionais, auditáveis e tecnicamente seguras”, além de expor sinal de idade por API para os provedores. E o regime sancionatório não é leve: multa de até 10% do faturamento do grupo econômico no Brasil, teto de R$ 50 milhões por infração, suspensão temporária das atividades, proibição de exercício das atividades e até ordem de bloqueio a provedores de conexão, DNS e outros intermediários.

Traduzindo do juridiquês para português de produção: a lei transforma acesso digital em checkpoint de identidade, espalha obrigação de compliance por toda a cadeia e, quando a conta não fecha, ameaça desligar o serviço.

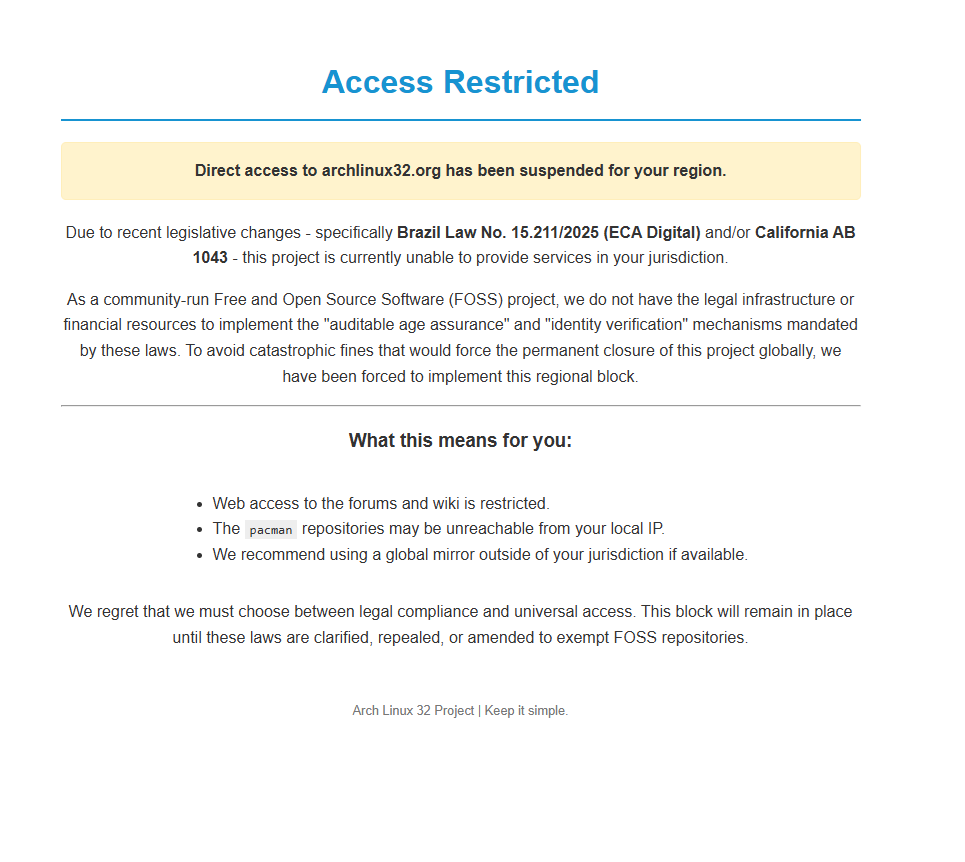

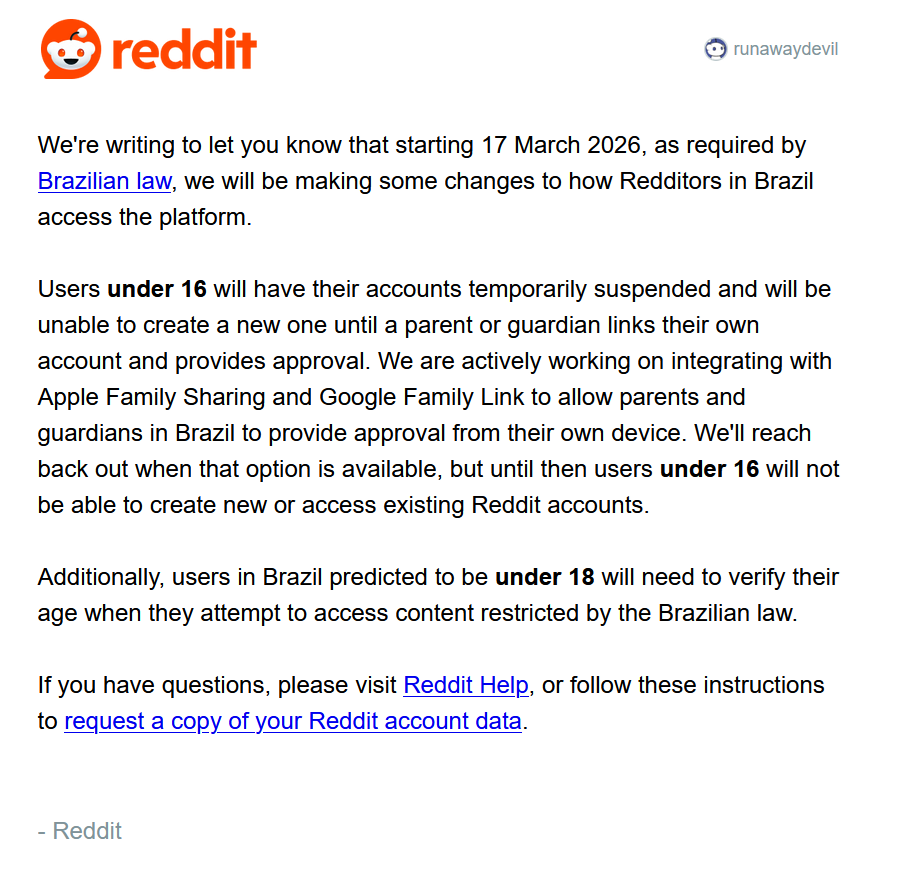

Um projeto comunitário como o Arch Linux 32 preferiu bloquear acesso regional a assumir risco jurídico e operacional que ele claramente não tem como bancar. O texto do aviso é brutal porque é honesto: FOSS pequeno não tem estrutura legal nem caixa para implementar mecanismo “auditável” de age assurance e identity verification sem correr risco existencial. Já o Reddit, no seu print, deixa claro o efeito colateral previsível: restrição adicional de contas, suspensão de acesso para parte dos usuários e ampliação da verificação etária. Quando a lei é desenhada sem levar em conta custo de implementação, quem não tem departamento jurídico sai do mercado ou fecha a porta para o Brasil.

Aí vem a primeira grande mentira vendida junto com esse pacote: “não é vigilância, é só proteção”. Isso é conversa fiada. Verificação obrigatória de idade, especialmente quando exigida repetidamente e integrada a sistemas operacionais, app stores e plataformas, amplia a coleta, o trânsito, a retenção e a superfície de risco de dados. O próprio texto legal tenta se defender dizendo que o sinal de idade por API deve observar minimização de dados e que os dados de verificação só podem ser usados para essa finalidade. Bonito no papel. Na prática, qualquer engenheiro decente sabe que criar mais pontos de coleta, mais integrações, mais intermediários, mais chaves de correlação e mais provedores terceiros é aumentar superfície de ataque, risco de vazamento, risco de erro e risco de uso indevido.

A própria ANPD admitiu o óbvio quando publicou o Radar Tecnológico nº 5: aferição de idade em ambiente digital tem dificuldade estrutural porque você está tentando tratar dados para determinar faixa etária sem destruir privacidade e segurança da informação no processo. O CGI.br bateu na mesma tecla ao recomendar proporcionalidade, minimização, inclusão digital, não fragmentação da internet, interoperabilidade e padrões abertos. Se o órgão regulador e o principal comitê técnico de governança da internet já estão avisando que o tema é delicado, complexo e perigoso, isso não é detalhe. Isso é alarme de arquitetura.

Tem mais. A crítica não é só técnica. Ela é constitucional.

Eu não vou vender fantasia jurídica barata e fingir que “já é inconstitucional” como fato consumado, porque isso depende de controle judicial. Mas existe, sim, tese fortíssima de inconstitucionalidade material. A Constituição protege a liberdade de expressão e de comunicação sem censura ou licença, protege intimidade e vida privada, protege sigilo de dados e também veda censura de natureza política, ideológica e artística. Além disso, a ordem econômica é fundada na livre iniciativa. O problema da Lei 15.211/2025 é que ela cria um sistema de acesso condicionado, com verificação compulsória, risco de bloqueio de serviços e efeito inibidor sobre circulação de informação e distribuição de software, sem demonstrar com clareza que esse é o meio menos intrusivo disponível.

Em bom português: quando o Estado diz que, para acessar parte relevante do ecossistema digital, você precisa se encaixar num sistema obrigatório de aferição etária distribuído por plataformas, sistemas operacionais, lojas e terceiros, ele está impondo fricção estrutural ao exercício de direitos fundamentais. E quando a sanção pode chegar a bloqueio técnico na rede, você sai da proteção pontual e entra no terreno da censura por infraestrutura. Chame do nome que quiser. O efeito concreto é esse.

“Ah, mas a lei quer proteger menor.” Sim. E esse objetivo é constitucionalmente legítimo. Só que direito fundamental de criança não autoriza qualquer engenharia de controle sobre toda a população. Direito constitucional sério não funciona no modo “fim nobre, dane-se o resto”. Tem adequação, necessidade e proporcionalidade. Tem colisão de direitos. Tem vedação de excessos. Tem o detalhe incômodo de que uma lei pode se declarar defensora da privacidade enquanto fabrica o maior incentivo regulatório possível para vigilância etária massificada.

E aqui entra um ponto que quase ninguém do oba-oba legislativo quis discutir: autocustódia e controle do próprio dado. Uma arquitetura decente de prova etária deveria, no limite, permitir que o usuário apresentasse apenas o mínimo necessário — por exemplo, um atestado criptográfico de “maior de 18” — sem entregar identidade civil completa, sem deixar rastro correlacionável entre serviços e sem centralizar tudo em provedores privados de KYC ou em plataformas que já sabem dados demais sobre todo mundo. A União Europeia já publicou um blueprint open source e privacy-preserving para verificação etária que separa emissão da credencial da sua apresentação, trabalha com atestações de uso único e tenta evitar rastreamento entre plataformas. O Brasil fez o contrário do que deveria fazer primeiro: impôs obrigação ampla agora e empurrou a solução técnica para depois, na base do “regulamenta aí”.

Isso viola o espírito da autocustódia porque o centro de gravidade do sistema não fica no usuário com uma credencial mínima e reutilizável sob controle dele. Fica nos validadores, nas plataformas, nas APIs obrigatórias, nas integrações de loja e sistema operacional e, inevitavelmente, nos intermediários de confiança. Ou seja: mais centralização, mais acoplamento e menos soberania do titular sobre a própria prova.

O resultado prático disso para software livre e distribuição de software é péssimo. Projeto pequeno não vai contratar parecer, DPO, fornecedor de biometria, time de compliance, suporte jurídico internacional e infra de auditoria para continuar servindo ISO, pacote, fórum e repositório para um país só. Ele vai fazer o racional: geoblock. Vai cortar IP brasileiro. Vai desativar cadastro. Vai empurrar usuário para mirror global informal. Vai desistir de distribuir binário aqui. Vai abandonar integrações locais. Vai parar de oferecer comunidade, wiki, issue tracker, fórum e artefato executável quando entender que qualquer erro pode virar multa, bloqueio ou litígio.

E isso gera uma cascata de merda:

- concentração de mercado nas big techs que conseguem bancar compliance;

- expulsão silenciosa de projetos independentes e comunitários;

- mais dependência de intermediários centralizados para provar idade;

- fragmentação da internet brasileira em relação à internet global;

- aumento de risco para privacidade sem garantia real de efetividade;

- criação de incentivos para contorno inseguro, como uso de VPN, mirrors obscuros e workflows paralelos;

- dano direto à pesquisa, à cultura técnica, ao hobbyismo, à educação informal e à experimentação que sempre moveram o software livre.

Tem ironia pior. A própria lei diz, no art. 5º, § 2º, que o melhor interesse da criança inclui privacidade, acesso à informação, liberdade de participação na sociedade e acesso significativo às tecnologias digitais. Só que a implementação burra da lei pode destruir exatamente isso. Criança e adolescente precisam de proteção, óbvio. Mas também precisam de internet aberta, acesso significativo à tecnologia, educação digital de verdade e ferramentas proporcionais. Não de uma catraca nacional de identidade disfarçada de cuidado.

E antes que apareça o gênio do “quem não deve não teme”: isso é frase de quem nunca modelou ameaça, nunca leu sobre vazamento em escala, nunca desenhou fluxo de autenticação e nunca entendeu a diferença entre identificar uma pessoa e verificar apenas um atributo. Em segurança séria, o objetivo não é coletar porque dá. É coletar o mínimo porque qualquer dado extra vira passivo.

A parte mais irritante desse circo todo é a origem política do desastre. Um tema gravíssimo — exploração de menores — foi engolido por lógica de espetáculo, pânico moral e oportunismo regulatório. Em vez de atacar crime, cadeia de exploração, falha de moderação, cooperação policial, educação parental, capacidade investigativa e responsabilização objetiva de casos realmente graves, preferiram a solução de vitrine: meter verificação etária ampla, distribuir obrigação para todo lado e posar de salvador da infância. É a estética da proteção com a substância da vigilância.

E não: eu não compro a versão romântica de que isso foi pura boa intenção mal executada. Quando gente com poder ignora aviso técnico, ignora custo para atores pequenos, ignora risco de vigilância, ignora fragmentação da rede e mesmo assim dobra a aposta, isso deixa de ser erro inocente. Vira escolha política. E escolha política ruim precisa ser chamada de ruim sem anestesia.

O apelido “Lei Felca” já diz muito sobre a degradação do processo. Política pública séria não devia nascer de ecossistema de viralização, pressão emocional e reward de engajamento. Quando o debate público vira performance, a lei sai performática também: agressiva no discurso, confusa na implementação e desastrosa no efeito sistêmico. Se a histeria social provocada por influencer, mídia e oportunista de plantão serviu de combustível para esse texto, então o país foi regulado no modo react de internet. E regular infraestrutura digital no modo react é coisa de irresponsável.

Meu ponto final é simples: essa lei vende proteção, mas entrega fricção, vigilância, centralização e exclusão. Ela pode até ser bem-intencionada em partes, mas foi desenhada com a delicadeza de um ransomware. Há fundamento sério para questionamento constitucional, há evidência técnica de risco à privacidade, há alerta institucional sobre proporcionalidade e há efeito concreto já aparecendo na forma mais previsível possível: serviços fechando a porta para brasileiros.

Estamos chegando perto do pior cenário: continuar sem segurança real contra os abusadores profissionais e, de quebra, colocar usuários comuns sob monitoramento crescente para acessar software, comunidades e informação. Isso não é avanço civilizatório. Isso é regressão embalhada como proteção. E, no fim, a conta sobra para a sociedade inteira, enquanto a classe política segue insistindo em respostas ideológicas, simplistas e fracassadas para problemas complexos que exigiam engenharia, prudência e respeito a direitos fundamentais.

Referências factuais e jurídicas

[1] Lei nº 15.211/2025 (DOU / Planalto) — escopo da lei, verificação de idade, APIs de sinal etário, sanções e bloqueio.

[2] Senado Notícias — resumo da lei, multas e vedação de autodeclaração.

[3] ANPD, Radar Tecnológico nº 5 — desafios de aferição de idade e privacidade.

[4] CGI.br — sete recomendações para implementação proporcional, com privacidade, inclusão e sem fragmentação da internet.

[5] Jornal da Unicamp — riscos de vazamento, retenção de dados e impacto mais grave em redes descentralizadas e iniciativas independentes.

[6] Constituição Federal de 1988 — art. 5º (liberdade de expressão, privacidade, sigilo de dados), art. 220 (vedação à censura) e art. 170 (livre iniciativa).

[7] EFF — age verification harms users of all ages; não existe método simultaneamente totalmente protetivo da privacidade e totalmente preciso.

[8] EDPB — age assurance impacta não apenas proteção de dados, mas também livre expressão, informação e não discriminação.

[9] Interoperable Europe / Comissão Europeia — blueprint open source e privacy-preserving para verificação etária com atestações de uso único e prevenção de cross-platform tracking.

Observação metodológica

As afirmações factuais foram baseadas nas fontes acima.